【エグゼクティブ・サマリー】

- 富士通がRapidusの次世代1.4nmプロセスを採用し、設計・製造ともに完全国内生産となるサーバー向けAI推論特化型NPUの開発を発表。

- 汎用GPUに依存しない高効率な推論処理を実現し、自社の次世代ArmベースCPU「Monaka」とのシングルパッケージ統合を計画。

- ハードウェアレベルの暗号化をチップに直接組み込み、「ソブリンAI(国家主権型AI)」に向けた強力なデータ保護と経済安全保障を牽引。

既存テクノロジーの限界と課題

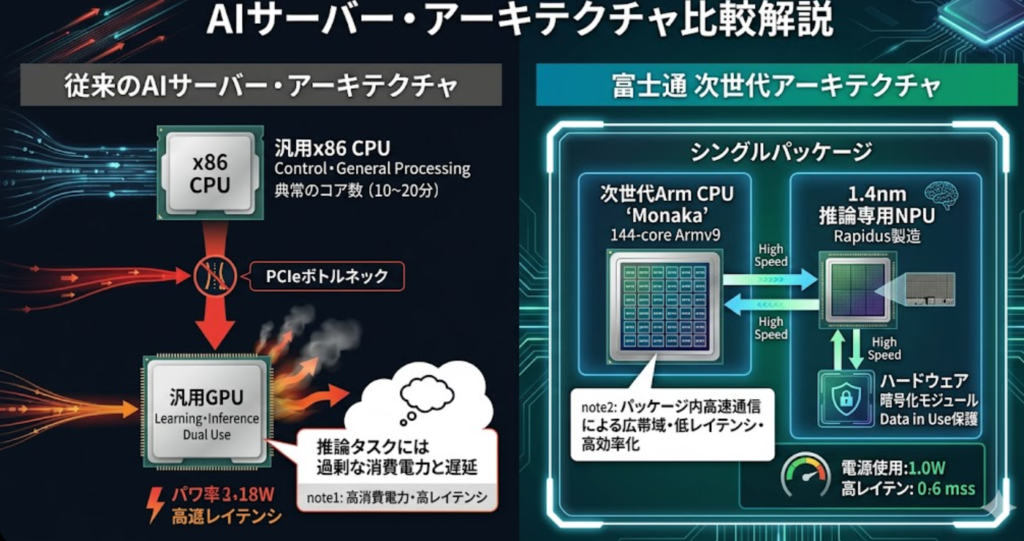

新たなアーキテクチャの優位性を理解するためには、現在のAIインフラが直面している物理的・構造的なボトルネックを整理する必要があります。

- 汎用GPUによる推論処理の電力・コスト限界: LLM(大規模言語モデル)の学習(Training)には並列処理に優れたGPUが不可欠です。しかし、サービス提供時の推論(Inference)フェーズにおいてもオーバースペックなGPUを使用し続けることは、ワットパフォーマンスの悪化と、データセンターの膨大な冷却・インフラコストを招いています。

- データセキュリティと「ソブリンAI」の欠如: 機密データや国家レベルの情報を処理する際、海外のパブリッククラウドや海外製プロセッサに依存することは、経済安全保障上の大きなリスク(バックドアの懸念やデータ漏洩リスク)となります。

- ファウンドリの地理的集中リスク: 最先端ノード(3nm/2nm等)の製造が特定の地域(主に台湾のTSMC)に極度に集中しており、地政学的リスクがITインフラサプライチェーン全体の致命的な弱点となっています。

ニュースの核心とアーキテクチャの優位性

Tom’s Hardwareの報道(元ソース:Nikkei Asia)によると、富士通はRapidusの次世代1.4nmプロセスを用いて、サーバーおよび関連システム向けのAI推論専用NPU(Neural Processing Unit)を開発する計画を明らかにしました。開発費用の約2/3(約580億円)は、NEDO(新エネルギー・産業技術総合開発機構)が支援する見込みです。

同記事では、このプロジェクトの意義について以下のように報じられています。

「このプロジェクトは、設計と製造の両面において完全に国内で製造されるNPUを実現するものである」

エンジニア視点から見た本技術のコアとなる優位性は以下の通りです。

1. サーバー特化型NPUによる推論効率の極大化

通常、NPUはPCやスマートフォンなどのエッジデバイスに搭載されますが、富士通はこれをあえてサーバーシステム向けに設計しています。並列処理に特化した巨大なGPUから推論タスクを専門のNPUにオフロードすることで、スループットと電力効率(Performance per Watt)を飛躍的に向上させるアプローチです。

2. 1.4nmプロセスとArmアーキテクチャの高次元統合

富士通は、次世代スーパーコンピュータ「Fugaku NEXT」等に向けて開発中の144コアArmv9アーキテクチャCPU「Monaka」(現行設計はTSMC 2nmを採用)と、今回の1.4nm NPUを単一パッケージ内に統合する計画です。チップレット化や高度なパッケージング技術により、CPU-NPU間のデータ転送帯域幅のボトルネック(従来のPCIe接続等)を解消し、極めて低いレイテンシを実現します。

3. ハードウェアレベルの暗号化によるゼロトラストの実現

チップ内に暗号化技術を直接組み込むことで、処理中のデータ(Data in Use)を保護する「コンフィデンシャル・コンピューティング」の概念をハードウェアで実装します。これにより、ソブリンAIの基盤として、機密性の高いデータを扱う国内インフラでの採用が強く後押しされます。

【図解】技術アーキテクチャ・関係図

【エンジニア視点】ITエコシステム・業界へのインパクト

この技術動向が将来のインフラストラクチャにどのような変化をもたらすのか、技術的な推論を交えて考察します。

- データセンター熱設計のパラダイムシフト1.4nmプロセスという極限の微細化技術は、トランジスタの高密度化による圧倒的な省電力化をもたらします。AI需要の爆発によりデータセンターの電力供給と冷却能力が物理的な限界(壁)に直面する中、NPUへの推論オフロードと1.4nmの採用は、今後のインフラ運用において必須の生存戦略となります。

- Rapidusのエコシステム形成とファウンドリとしての証明Rapidusにとって、本件はキヤノンに続く2例目の確定受注(予定)となります。2027年後半の2nm量産開始、そして2029年頃の1.4nm量産を目指す上で、HPC(ハイパフォーマンス・コンピューティング)やサーバー向けハイエンドチップの製造実績は、先端ファウンドリとしての歩留まりや技術力を世界に証明する強力な試金石となります。

- データセンターにおけるArmアーキテクチャの支配力強化クラウドインフラにおいてArmベースのプロセッサ(AWS Gravitonなど)はその電力効率の高さから急速にシェアを拡大しています。富士通の「Monaka」と推論NPUの統合ソリューションは、サーバー市場におけるArmの優位性をさらに強固なものにし、既存のx86陣営に対する強力な対抗馬となるでしょう。

まとめ

富士通とRapidusによる1.4nm AIチップの共同開発は、単なる「国産回帰」のニュースではありません。AI推論に最適化されたアーキテクチャへのシフト、ハードウェアレベルでのセキュリティ実装、そして次世代微細化プロセスの確立という、現代のテクノロジーが抱える電力・帯域幅・地政学的なボトルネックを突破する極めて論理的なアプローチです。このプロジェクトが成功すれば、2020年代末のデータセンター設計に大きなパラダイムシフトをもたらすことになります。

引用元記事

Fujitsu plans dedicated 1.4nm AI chip manufactured entirely in Japan by Rapidus

コメント