【エグゼクティブ・サマリー】 Arm Holdingsが、自社初のサーバー向けCPU「AGI CPU-1」を発表。136コア・300W TDPというx86を圧倒する電力効率を武器に、MetaとOpenAIを初期顧客として確保した。エージェンティックAIが従来比15倍以上の推論処理を生み出す時代において、Armはライセンス供与企業から半導体メーカーへと、40年のビジネスモデルを根底から転換しつつある。

既存テクノロジーの限界と課題

エージェンティックAIの台頭は、データセンターのCPUリソースに対して、これまでとはまったく異なる圧力をかけはじめている。

従来のLLM(大規模言語モデル)利用では、人間がチャットボットを操作するペースでリクエストが発生していた。しかし、複数のAIエージェントが自律的にAPIを呼び出し、他のモデルを連鎖的にオーケストレートする「エージェンティックAI」環境では、推論リクエストの発生頻度は人間操作型の15倍以上に達すると予測されている。

これはCPUアーキテクチャにとって何を意味するか。推論処理はGPU/アクセラレータ側で完結せず、ホストCPUがリクエストのルーティング、メモリ管理、ネットワークスタックの処理、セキュリティポリシーの適用を担い続ける。GPUが処理する「深さ」ではなく、CPUが捌く「幅(スループット)」がボトルネックになる構造だ。

また、従来のx86サーバーCPUが抱える課題も無視できない。

Intelの「Granite Rapids」Xeon 66980P(128コア)はSMT(同時マルチスレッディング)込みで500W、1コアあたり3.9Wを消費する。「Sierra Forest」Xeon 6(144コア)は330Wと改善されているが、2.3W/コアのまま、クロック周波数は2.2GHzに留まる。

SMT自体もAI推論の現場では必ずしも有益ではない。コア間でキャッシュとリソースを共有するSMTは、決定論的なレイテンシを要求するAI推論処理において予測困難な揺らぎを生じさせ、さらにSMTはSpectreなどのサイドチャネル攻撃の攻撃面を広げるセキュリティリスクでもある。

電力制約が最大の課題となる1GW超のハイパースケールAIデータセンターにおいて、「1コアあたりの消費電力」は設計の根幹を左右するパラメータだ。この文脈において、x86アーキテクチャの設計哲学は構造的な限界に近づいていると言える。

ニュースの核心とアーキテクチャの優位性

The Next Platformの2026年3月25日付レポートによると、Arm HoldingsのCEO Rene Haas氏が、同社初となる自社設計のサーバーCPU「AGI CPU」を正式に発表した。発表イベント「Arm Everywhere」において、Arm Cloud AIのEVPであるMohamed Awad氏は、このCPUの開発が約3年前にMeta Platformsからの要請で始まったことを明らかにした。OpenAIも初期顧客として名を連ねており、第1ロットは今年後半に量産出荷が開始される予定だ。

Awad氏は次のように述べている。

「顧客はArmに対して、完成したCPUデザインだけでなく、そのまま使えるCPU製品として提供してほしいと求めていた。最初にそれを求めてきたのが、3年前のMeta Platformsだ。」

コアアーキテクチャ

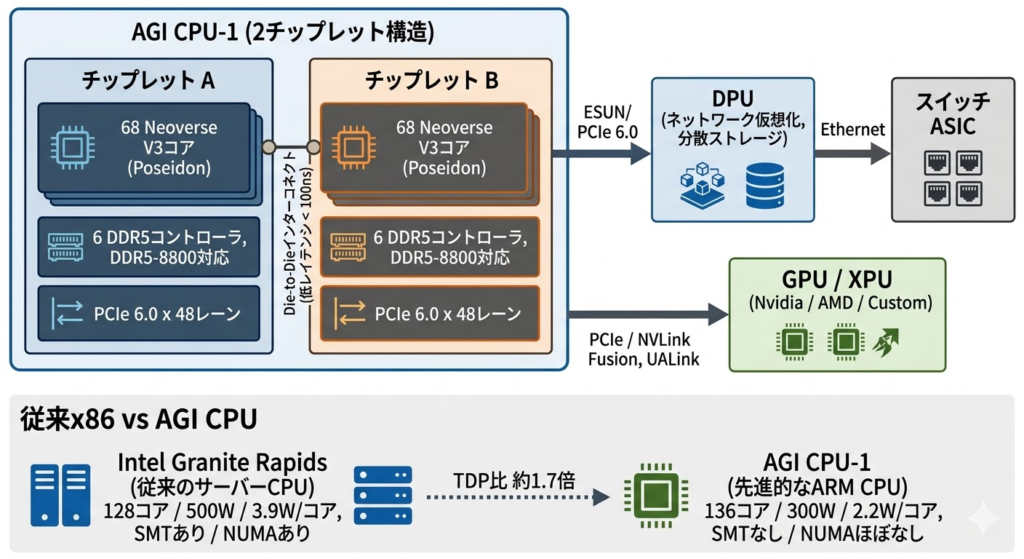

「AGI CPU-1」(The Next Platformによる仮称)は、以下の仕様を持つ。

- コア数: 136コア(Armv9.2命令セット対応「Poseidon」Neoverse V3コア)

- 製造プロセス: TSMCのN3プロセス(3nmクラス)

- チップレット構成: 2チップレット構造、各チップレットに60コア(+補助コア)

- クロック周波数: 最大3.7 GHz

- SMT: 非搭載(意図的設計)

- TDP(熱設計電力): 300W(2.2W/コア)

メモリサブシステム

- DDR5コントローラ: 12基(各チップレットに6基)

- DDR5-8800対応、最大メモリ帯域: 844.8 GB/秒

- 1コアあたり帯域: 約6.2 GB/秒

I/Oサブシステム

- PCI-Express 6.0: 96レーン(ソケットあたり)

- MetaのESUNメモリコヒーレンシプロトコルへの対応を示唆

2チップレット設計の技術的合理性

AMDやIntelが採用する「I/O die + Compute die」分離型チップレット構造とは異なり、AGI CPU-1はI/Oとコンピュートコアをひとつのチップレットに統合した「統合型チップレット」を2個並べる構成を取る。これによりNUMAドメインの分断を最小化し、全コアが100ナノ秒以内に全メモリにアクセスできる低レイテンシ設計を実現している。AI推論のバッチ処理においてはメモリアクセスの均質性が性能の決定要因となるため、このNUMA設計の優位性は大きい。

x86との比較

| 指標 | AGI CPU-1(Arm) | Granite Rapids(Intel) | Sierra Forest(Intel) |

|---|---|---|---|

| コア数 | 136 | 128 | 144 |

| TDP | 300W | 500W | 330W |

| W/コア | 2.2W | 3.9W | 2.3W |

| 最大クロック | 3.7 GHz | 2.0 GHz | 2.2 GHz |

| SMT | なし | あり | なし |

Awad氏の発表によると、AIワークロードにおいてAGI CPU-1の1スレッドあたり性能は対象x86コア比で約1.3倍を達成。SMTをオンにしたx86はむしろスレッド単位の性能が低下するケースもあり、AGI CPUの電力効率での優位は明確だ。

市場規模と収益戦略

Haas氏は2030年までのエージェンティックAIシステム向けCPUのTAM(総市場規模)を1,000億ドルと試算。ArmはAGI CPU製品群だけで2031年までに150億ドルの収益達成を目標として掲げており、従来のNeoverse IPライセンス収入と比べても桁違いのインパクトを持つ。

【図解】技術アーキテクチャ・関係図

【エンジニア視点】ITエコシステム・業界へのインパクト

1. ハイパースケーラーの自社チップ戦略への波及効果

Meta、Google(Axion)、Amazon(Graviton)、Microsoft(Cobalt)といったハイパースケーラーは、いずれも自社設計のArmサーバーCPUを持つ。一見するとAGI CPUはこれらの競合に見えるが、Awad氏が強調するようにArmの設計はこれらカスタムCPUと互換性がある。

実際のダイナミクスはより複雑だ。自社チップ設計チームを持たない大企業やエンタープライズ企業(AWSやGCPのような自前クラウドを持たないモデルビルダーを含む)にとって、AGI CPUは「設計コストゼロで最先端のArmコアを入手できる」手段となる。MetaとOpenAIが真っ先に採用したのは、両社がx86ベンダーの価格設定に束縛されない「自由なチップ調達者」であることと整合的だ。

さらに、ハイパースケーラーが自社チップ設計に割く工数を削減し、AGI CPUをベースラインとしてデファクト化する可能性もある。この場合、ArmはIPライセンス料収入に加えてハードウェア粗利を積み上げる二重収益構造を得ることになる。

2. x86の真のライバルはArmではなくTCO

今回の発表においてx86がスケープゴートとして描かれているが、インフラエンジニアの視点では問題の本質は別にある。1GWデータセンターにおいて、CPUのWallclock消費電力の削減は冷却コスト・PUE・設備投資の連鎖削減を意味する。

Haas氏の試算では、1GWのAIデータセンターには最低でも1億2,000万コアが必要とされる。300WのAGI CPU(136コアと仮定)が約882,000ソケット、同等コア数のGranite Rapids(500W)なら約937,500ソケット——この電力差が累積すると、冷却インフラ・バックアップ電源・空調の規模に直結する。データセンター運用者にとってTDP削減は単なるグリーン指標ではなく、CFOを動かすCapEx/OpExの問題だ。

3. SMT排除は「信頼性の設計」

SMT非搭載は一見するとスペックダウンに映るが、これは意図的な設計判断だ。AI推論サービスにおいては、テール・レイテンシ(P99/P999)のコントロールがSLAの核心となる。SMTが有効な環境ではコアがリソースを共有するため、バーストトラフィック時に処理時間の分散が広がる。SMTを排除することで各コアのパフォーマンスが決定論的となり、インフラエンジニアは容量計画のモデルをシンプルに保てる。Ampere Computingが同じ哲学を持っていたことも示唆的だ——SoftBankがAmpereを65億ドルで買収した背景には、Armの第2チップ設計チームとして機能させる意図があるとThe Next Platformは推測している。

4. Metaが推進するESUNプロトコルの存在感

記事中に言及される「ESUNメモリコヒーレンシプロトコル」はまだ広く知られていないが、PCIe 6.0ベースのファブリックを通じてCPUとDPU・スイッチ間でメモリ空間を論理的に統合するプロトコルだ。これが普及すれば、CPUのDRAMとアクセラレータのHBM、果てはリモートノードのメモリを単一アドレス空間として扱えるようになり、現在のPCIeボトルネックを大幅に緩和できる。MetaがAGI CPU採用と並行してESUN標準化を進めているとすれば、これは単なるCPU調達戦略を超えたインターコネクト・スタック全体の標準化戦略と読み取れる。

まとめ

Armが自社ブランドのサーバーCPUを市場投入するという今回の発表は、単なる製品ローンチを超えた戦略的転換点だ。40年間「IPライセンサー」として半導体業界の裏側に徹してきたArmが、MetaとOpenAIという最も要求水準の高い顧客を引き連れてシリコンビジネスに参入した。

技術的には、136コア・300W TDP・DDR5-8800対応という仕様は、エージェンティックAI時代が要求する「高コア数×低消費電力×低レイテンシメモリ帯域」の三要素を高度にバランスさせた設計であり、SMT排除と統合チップレット構造による決定論的性能はAI推論ワークロードへの明確な最適化を示している。

2031年に150億ドルという収益目標を掲げるArmの勝算は、価格設定と年次ロードマイン遵守にかかっている。IntelとAMDが構築してきたx86エコシステムの壁は厚いが、GPUとXPUがArm CPUとペアリングされるという現実が既成事実化しつつある今、データセンターのCPU設計原則が静かに、しかし確実に書き換えられようとしている。

引用元記事

Arm Comes Full Circle With Homegrown, AI-Tuned Server CPU(The Next Platform, 2026-03-25)

コメント