【エグゼクティブ・サマリー】

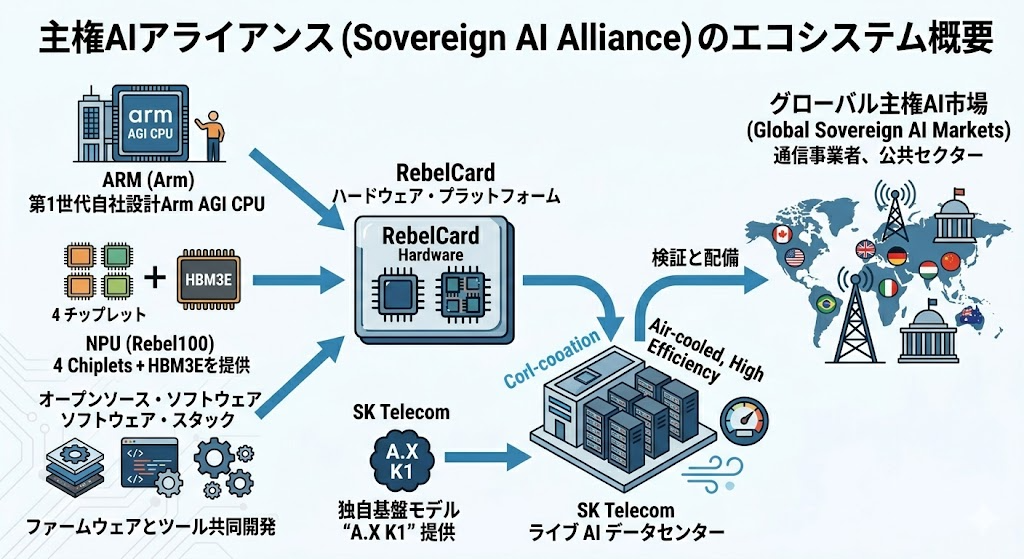

- 韓国SK Telecom、Rebellions、英Armの3社が提携し、特定ベンダーに依存しない主権的AI(Sovereign AI)インフラの構築計画を発表しました 。

- Arm初の内製CPUとRebellionsのNPU、HBM3Eを統合したアクセラレータ「RebelCard」を2026年第3四半期に投入予定です 。

- 既存設備のまま運用できる「空冷」設計を採用し、SKの独自基盤モデル「A.X K1」を用いて実際のデータセンター環境で検証が行われます 。

既存テクノロジーの限界と課題

現在のAIインフラストラクチャ、特に大規模言語モデルの推論環境は、いくつかの構造的なボトルネックに直面しています。

- 特定ベンダーへの極端な依存(ロックイン): 現在のAI開発・運用は、CUDA(※NVIDIAが提供するGPU向けの並列コンピューティングプラットフォーム)というソフトウェアとNVIDIA製GPUの組み合わせに大きく依存しています 。これにより、インフラの選択肢が狭まり、サプライチェーンの柔軟性が失われています 。

- 液冷システムの導入ハードル: 最新のハイエンドGPUは消費電力が極めて高く、データセンターに高価で複雑な液冷(水冷)システムの導入を強いています 。これは、既存の通信局舎やデータセンターを流用する際の大きな障壁です。

- データ主権の喪失リスク: 海外のプロバイダーやチップメーカーに完全に依存することは、国家や企業が自らのデータやAIモデルのコントロールを失うという安全保障上の懸念(Geopolitical anxiety)を引き起こしています 。

ニュースの核心:垂直統合で挑む「AIインフラの独立」

今回発表された提携の最大の特徴は、インフラの設計から実際のデータセンターでの検証まで、バリューチェーン全体を一貫してカバーしている点です 。

Sovereign AI Infrastructure(主権的AIインフラ)とは、特定の海外ベンダーに依存せず、自国の技術やデータ主権を維持しながら構築するAI計算基盤のことです 。

AIインフラを「巨大なレストランの厨房」に例えてみましょう。 現在は、特定の海外メーカーが作った特殊なガスコンロ(GPU)と、彼らの専用レシピ本(CUDA)がないと、まともな料理(AI処理)が作れない状態です。 今回の提携は、「自分たちの国の食材(機密データ)を安全に調理するために、独自のコンロ(RebellionsのNPU)と、それを制御する優秀なシェフ(ArmのCPU)、そして実際の店舗(SKの通信データセンター)を全部自分たちで用意してテストしよう」という試みです。

ハードウェアの中核となるのは、Rebellionsが2026年第3四半期に市場リリースを予定している「RebelCard」です 。このカードは以下の強力な構成を持っています。

- Arm AGI CPU: Armが社内で設計した初のCPUが採用されます 。

- Rebel100 AI半導体: 4つのNPU(※Neural Processing Unit:AI処理に特化した演算回路)チップレットを統合しています 。

- HBM3E(※第5世代広帯域メモリ): 大量のデータを瞬時にやり取りできる超高速メモリを搭載しています 。

RebelCardは、これらのチップ間で高速な通信を行い、大規模なマルチモーダルモデルやMoE(※Mixture of Experts:複数の専門モデルを組み合わせて効率良く推論する技術)の実行に最適化されています 。 そしてインフラ設計における最大の強みは、このカードが標準的な「空冷(Air-cooled)」で動作するように設計されている点です 。高騰する冷却コストに悩まされることなく、フラッグシップGPUと同等のパフォーマンスを優れた電力効率で発揮すると主張されています 。

検証はラボの中ではなく、SK TelecomのライブAIデータセンターで、彼らの独自基盤モデル「A.X K1」を使って行われます 。実際の通信キャリア規模のデータ処理ワークロードに耐えられるかが証明されることになります 。

【比較表】従来アーキテクチャとのスペック比較

| 項目 | 従来型AIインフラ(特定ベンダー主導) | 新生Sovereign AIインフラ(Arm/SK/Rebellions) |

| 演算プロセッサ | 最新ハイエンドGPU | Rebel100 NPU(4チップレット) + Arm AGI CPU |

| メモリ規格 | HBM3 / HBM3E | HBM3E搭載 |

| 冷却方式 | 液冷(水冷)システムへの移行が必須 | 標準的な空冷(Air-cooled)に最適化 |

| ソフトウェア | クローズドな独自規格(CUDA等) | オープンソースおよびオープン標準ベース |

| 検証環境 | 各社ベンチマーク環境 | SK Telecomのライブデータセンター(A.X K1モデル) |

| 主要ターゲット | 汎用クラウド・AI学習全般 | Sovereign AI、通信キャリア、アジアの公共部門(推論中心) |

【図解】技術アーキテクチャ・関係図

【考察】ITエコシステム・業界へのインパクト

この垂直統合プロジェクトは、NVIDIA一強のインフラ市場構造に楔を打ち込むポテンシャルを秘めています。

第一に、データセンターの「ファシリティ制約からの解放」です。ハイパースケーラーではない一般的な企業や通信事業者にとって、液冷設備の導入は莫大な初期投資と改修を伴います 。空冷で稼働し、ワット当たりのパフォーマンス(Performance-per-dollar-per-watt)に優れるRebelCardが公称通りの性能を発揮すれば、既存の局舎やデータセンター資産を活かしたまま、大規模なAI推論環境を構築可能になります 。

第二に、通信インフラの「AIネイティブ化」の加速です。通信キャリアのエッジ側で高度なAI推論を行うニーズが高まる中、Armアーキテクチャと国産NPUを採用することは、サプライチェーンの強靭化の観点で極めて理にかなっています 。

しかし、ハードウェアのスペックだけで覇権は握れません。最大の障壁は、顧客が求めるツールやサポート統合といったエコシステムの成熟度です 。今回の提携ではオープンソースベースのフルスタックソフトウェアを共同開発するとしていますが 、これが現場の開発者にとって真に実用的なレベルに達するかどうかが、ビジネススケールの鍵を握るでしょう 。

まとめ

「自国のAIインフラを他国に依存したくない」という地政学的な動機が、Sovereign AIという巨大な新市場を形成しています 。Arm、SK Telecom、Rebellionsの提携は、単なる新型チップの発表ではなく、国家レベルのインフラ自立に向けた実証実験です 。実際の通信キャリアの環境下で、空冷稼働するNPUの実力が証明されれば、過熱する液冷GPU競争に対する現実的なオルタナティブとして、インフラ設計の常識を覆す可能性があります 。

引用元記事・補足資料

- Rebellions, SK Telecom, and Arm join forces to build sovereign AI infrastructure:Rebellions、SKテレコム、ArmによるSovereign AIインフラ構築に向けた提携を報じるニュース記事(2026-04-15発行)。

- SK Telecom Press Release:SKテレコムの公式発表資料。実環境での検証ロードマップに関するデータ。

- Arm for Cloud AI and Converged Data Centers:Armによるデータセンター向けAIインフラおよび空冷最適化に関する戦略資料。

コメント